Von Michael Limburg unter Verwendung von Texten von Dr. Bernd Fleischmann

Wie jeder hier weiß, ist Prof. Dr. Stefan Rahmstorf, der Held der Friday for Future Bewegung, ordentlicher Professor für Physik der Ozeane der Uni Potsdam, Leitautor des IPCC und seit 1996 Forscher am Potsdam Institut für Klimafolgenforschung (PIK). Er ist Träger vieler Preise, hält div. Ehrenämter und was weiß ich noch alles, aber ist vor allem ein unermüdlicher, vor allem medialer Warner vor den Schrecken der kommenden Klimakatastrophe, und beruft sich dazu als großer Bewunderer auf Svante Arrhenius, dem schwedischen frühen Nobelpreisträger und Mitbegründer der Lehre vom (menschgemachten) Klimawandel dank CO2.

Gibt man die Suchbegriffe Rahmstorf + Arrhenius bei Google ein, so werden einem in nur 0,32 sec 16.800 Treffer angeboten. Und das ist auch korrekt, denn Rahmstorf lässt keine Gelegenheit aus, auf die profunden Ergebnisse des Svante Arrhenius zu verweisen, zuletzt selbst erlebt anlässlich eines Vortrages im Deutschen Bundestag im Oktober 2019[1]. Dabei schlägt er fast immer den vorwurfsvollen Unterton an, dass der fatale menschliche Einfluss auf das Weltklima – mittels seines klima- und naturschädigenden CO2 Ausstoßes – nunmehr seit über 100 Jahren bestens bekannt sei, die Physik dafür also so fest wie eine germanische Eiche (meine Worte) stünde, und trotzdem die Menschheit, oder Regierung, oder irgend ein wichtiges Gremium wie die UN, darunter macht er es nicht, immer noch zu wenig täte, um der mit Gewissheit kommenden Klimakatastrophe Einhalt zu gebieten.

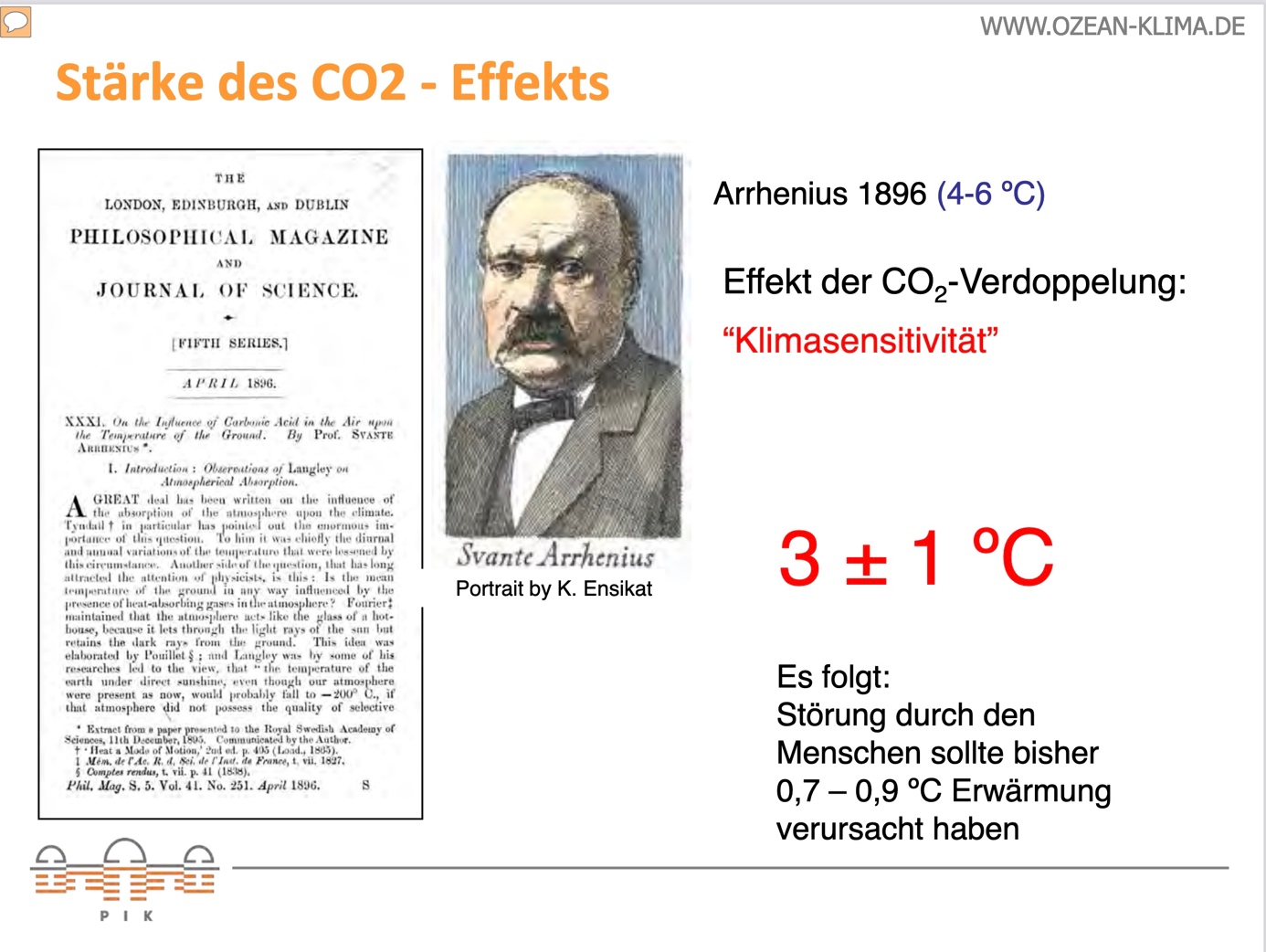

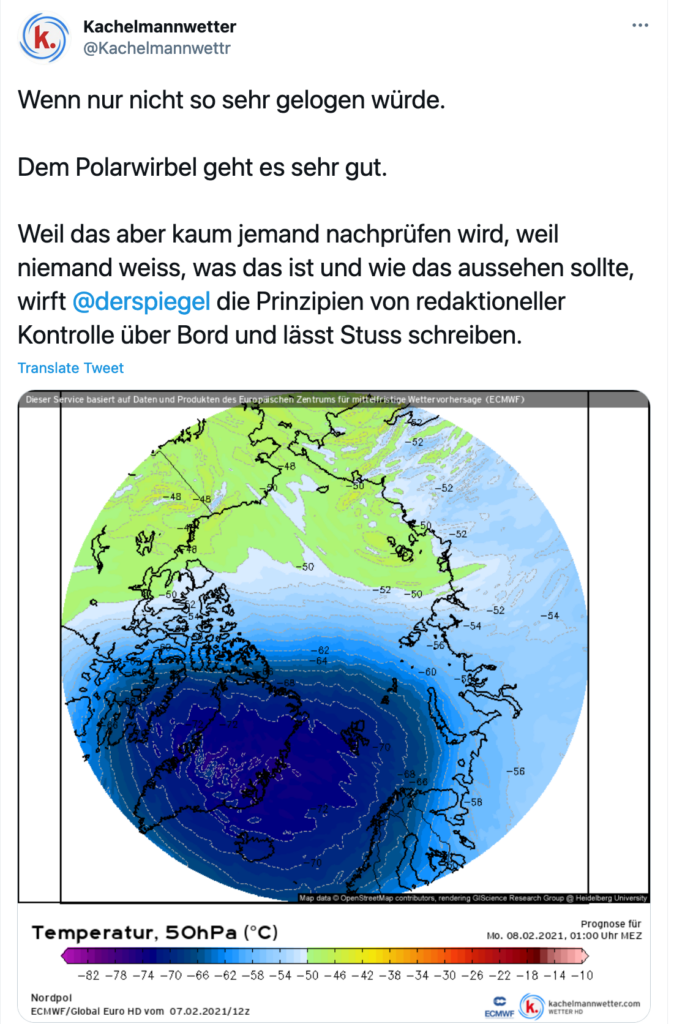

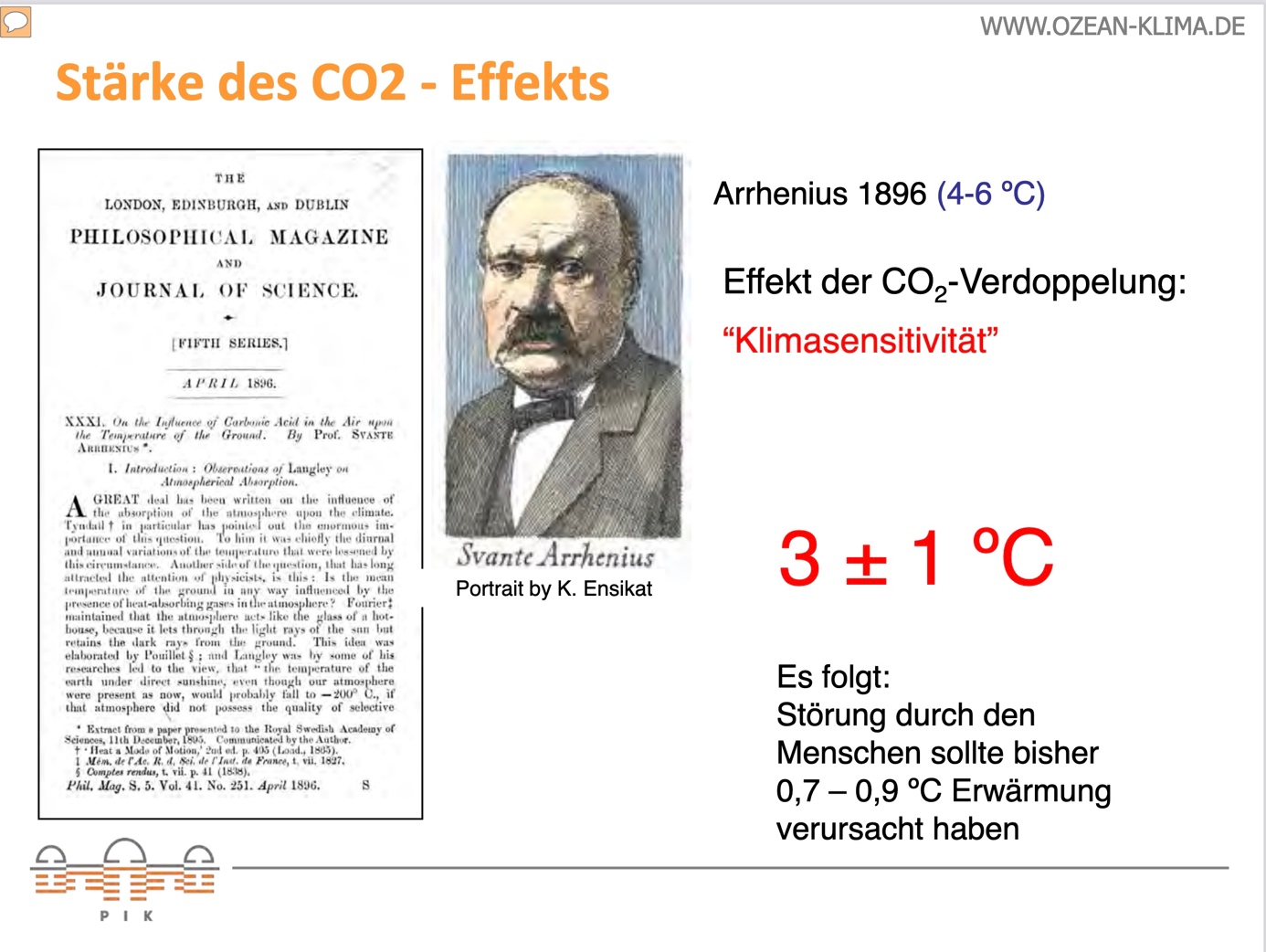

Dazu benutzt er auch gern die folgende Grafik (bspw. hier), die zeigt, dass Arrhenius schon 1896 „errechnet“ hatte, dass eine Verdopplung des CO2 Gehaltes der Atmosphäre, eine Erwärmung von 4-6 Kelvin zur Folge hätte.

Bild 1: Folie aus einem Vortrag von Stefan Rahmstorf „Die Klimakrise“ von 2013,

Und leitet daraus ab, dass es heute 3 ± 1 ° seien, (als „best estimate“ wie das IPCC diesen Wert nennt) wie er apodiktisch auf der Folie behauptet.

Was stört wird weggelassen

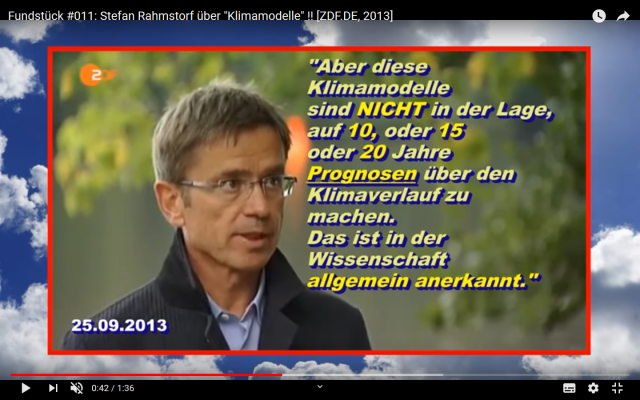

Dabei lässt er geflissentlich weg, dass seine Kollegen vom IPCC im selben Jahr 2013 entnervt festgestellt hatten (IPCC, 2013, p. 16), wenn auch nur in einer vielfach überlesenen Fußnote 16, dass es ihnen unmöglich sei, einen „best estimate“ für diesen Wert anzugeben, weil sie sich nicht über dessen Größe hätten verständigen können. Stattdessen gaben sie dafür einen Bereich von 1,0 bis 6,0 Kelvin an. Also minimal 1 Kelvin bei Verdopplung bis zu maximal 6 Kelvin. Darunter und darüber sei es „very unlikely“.

Immerhin gelte aber die Aussage „likely“ mit „high confidence“ (was aber nicht mit einem wahrscheinlichkeitsmathematischem Vertrauensbereich verwechselt werden darf, sondern ausschließlich auf der Meinung sog. Experten beruht), dass der Wert also das „best estimate“ irgendwo zwischen 1,5 und 4,5 Kelvin läge. Wobei festzuhalten ist, dass 1 bis 2 Kelvin mehr in unabsehbarer Zukunft, keinerlei Gefahr bedeuten würden, während 4,5 bis 6 Kelvin schon einiges an Anpassung erforderte.

Summa summarum bedeutet diese, seit über 30 Jahren und vieler milliardenschwerer Forschung unveränderte Einschätzung nur, dass die vom IPCC zitierten Wissenschaftler keinerlei Fortschritte in dieser alles entscheidenden Frage gemacht haben. Alles entscheidend deswegen wenn man an das irrwitzige Klimaurteil des Bundesverfassungsgerichtes denkt, dass sich, wenn auch indirekt, auf diese falsche Hausnummer beruft und sein Urteil mit dem „Restbudget“, aus dieser Zahl fälschlich abgeleitet, begründet.

Ähnlich großzügig bei der Weglassung unbequemer Ergebnisse verhält sich Rahmstorf auch beim über den grünen Klee loben des „herausragenden“ Wissenschaftlers Arrhenius, wenn er z.B. weglässt, dass dieser schon kurz nach Veröffentlichung seiner Idee von der Wirkung des CO2 auf die Temperatur, von prominenten Zeitgenossen wie z.B. Knut Ångstrom widerlegt wurde. Und das auch noch mehrfach und gründlich.

Dr. Bernd Fleischmann – Autor des vorzüglichen Werkes „Warum sich das Klima ändert – und eine Katastrophe ausbleibt – hat dazu einiges recherchiert. (Der Autor betreibt seine eigene Websseite „Klimawahrheiten.de„).

Ich erlaube mir daher seine Ergebnisse hier vorzustellen (ab Seite 13 der pdf Version).:

Zitat: „Arrhenius wandte dann seine falsche Theorie auf das „Treibhaus Erde“ an. Statt Fensterglas nahm er die „Treibhausgase“ Wasserdampf (H2O) und Kohlendioxid (CO2), welche die sichtbaren Sonnenstrahlen auf die Erde durchlassen, die von der Erde abgestrahlten Infrarotstrahlen aber teilweise absorbieren. Er bezog sich in seinen Arbeiten von 1896 und 1901 auf John Tyndall, der die Absorption der Wärmestrahlung der Erde durch das CO2 in der Atmosphäre gemessen hat. Manche bezweifeln das jedoch und sagen er hat mit seinem Messaufbau nur die Absorption durch Wasserdampf messen können. Dessen Ergebnisse, behauptete Arrhenius „stimmen sehr gut mit meinen Versuchen überein“, verschwieg dabei aber, dass er die Ergebnisse von Tyndall durch 3,6 dividiert hatte. So etwas nennt man Betrug! (http://www.kolumbus.fi/boris.winterhalter/PDF/ArrheniusCO2.pdf).

Abgesehen davon hat Arrhenius mit seinem Messaufbau die Absorption durch CO2 gar nicht messen können.

Er hat stattdessen die Absorption durch Wasserdampf gemessen (http://www.kolumbus.fi/boris.winterhalter/PDF/ArrheniusCO2.pdf). Dass Arrhenius völlig daneben lag, hat bereits sein schwedischer Zeitgenosse Knut Ångström (Erfinder des elektrisch kompensierten Pyrhelimeters, Sohn des berühmten Anders Jonas Ångström und wie dieser Professor der Physik und Astronom) nachgewiesen und in den „Annalen der Physik“ im Jahr 1900 publiziert (http://www.realclimate.org/images/Angstrom.pdf). Man wusste zu dieser Zeit bereits, dass die Absorptionsbanden von Kohlendioxid (man verwendete damals üblicherweise den Begriff Kohlensäure und nicht Kohlendioxid) sehr schmal sind. Einen der Fehler von Arrhenius beschreibt Ångström so (die Schreibweise entspricht dem Originaltext, die Hervorhebung ist von mir):

„… findet Hr. Arrhenius für die Kohlensäure eine Absorption, die über den grössten Teil des ultraroten Spectrums verbreitet ist. Dass unter diesen Umständen die Berechnung der quantitativen Werte der Absorption sehr fehlerhaft ausfallen muss, ist ziemlich klar.“ Mir ist das auch klar, vielen Klimaforschern offenbar deshalb nicht, weil Fakten keine Rolle spielen, solange eine Behauptung ins politische Konzept passt.

Ångström schreibt auch, dass sich an der Absorption durch Kohlendioxid in der Atmosphäre nicht viel ändert, wenn man die CO2-Menge auf 20 % des damaligen Wertes reduziert, was richtig ist. Arrhenius hat dagegen behauptet, „die Veränderungen in der Absorption würden colossal mit dem Kohlensäuregehalt variiren“ was natürlich falsch ist, wie fast alles, was von Arrhenius stammt.

Friedrich Paschen hat bereits 1894 nachgewiesen, dass eine 7 cm dünne Schicht Kohlendioxids die Strahlung in dessen Hauptband komplett absorbiert (https://tinyurl.com/ybqwu83z). Er hat entscheidend an der experimentellen Bestätigung des Strahlungsgesetzes von Max Planck mitgearbeitet und war einer der besten Physiker und Messtechniker seiner Zeit. Deshalb wurde er 1924 Präsident der Physikalisch-Technischen Reichsanstalt, der heutigen Physikalisch-Technischen Bundesanstalt (https://de.wikipedia.org/wiki/Friedrich_Paschen_(Physiker)). Die Arbeiten von Arrhenius zur Kohlendioxid- Absorption gerieten anschließend zu Recht in Vergessenheit. Dass sich heute kaum jemand an Knut Ångström und Paschen erinnert und Arrhenius dafür in aller Munde ist, finde ich sehr merkwürdig.

In Arrhenius Buch „Worlds in the Making” (https://archive.org/details/worldsinmakingev00arrhrich/page/42) steht auf Seite 42, dass es am Südpol mit durchschnittlich -10 °C um 10 °C wärmer sei als am Nordpol. Damit lag er um schlappe 40 °C daneben (die mittlere Temperatur am Südpol ist etwa -50 °C)! Soviel zu seinem Verständnis von der Erdatmosphäre.

Auf Seite 48 beschreibt er, wie er auf die Mitteltemperatur der Venus von 40 °C kommt. Tatsächlich sind es 464 °C! Bei der Mitteltemperatur für den Mars lag er „nur“ um 93 °C daneben. Ein echter Klimaexperte eben… Wie kommt jemand auf die Idee, anzunehmen, dass die von Arrhenius „berechneten“ 4 °C Temperaturerhöhung auf der Erde bei einer Verdoppelung des CO2-Gehalts der Atmosphäre auf physikalischen Zusammenhängen basieren (https://archive.org/details/worldsinmakingev00arrhrich/page/52)?

Allemal interessanter ist auf Seite 56 sein Zitat des polnischen Botanikers Godlewski, der bereits 1872 das Pflanzenwachstum bei unterschiedlichem CO2-Gehalt der Luft untersuchte und feststellte, dass es bei den von ihm untersuchten Pflanzen proportional mit dem CO2-Gehalt zunimmt. Mehr CO2 ist besser!

In seinem Aufsatz „On the Influence of Carbonic Acid in the Air upon the Temperature of the Ground” aus dem Jahr 1896 (https://tinyurl.com/y5h2vavg) geht Arrhenius am Ende auf mögliche Ursachen für das Auftreten von Eiszeiten ein und behauptet, dass diese durch einen Rückgang des CO2-Gehalts um 38 bis 45 % entstanden sind. Diese Theorie wurde bereits vor mehr als 100 Jahren widerlegt von Knut Ångström, Eva von Bahr, Emanuel Kayser und anderen (https://tinyurl.com/y3knmjj6).

Arrhenius nennt in seiner Arbeit auch die Theorie des schottischen Wissenschaftlers James Croll über die Exzentrizität der Erdbahn um die Sonne als Ursache für die Eiszeiten. Croll beschrieb 1864, dass die Exzentrizität dazu führt, dass in periodischen Abständen von zigtausend Jahren die Arktisregion weniger intensiv von der Sonne beschienen wird, die Schnee- und Eisflächen deshalb größer werden und dadurch mehr Sonnenstrahlung reflektiert wird, was die Abkühlung verstärkt. Arrhenius lehnte diese Theorie rundwegs ab. 1924 hat der serbische Ingenieur Milanković die Schwankungen der Exzentrizität und anderer Erdbahnparameter genauer berechnet und die Übereinstimmung mit den Eiszeitzyklen nachgewiesen. Arrhenius lag also auch hier falsch.

Arrhenius irrlichterte auch bezüglich Panspermie, Immunchemie und Astrophysik (mit falschen Theorien zu Kometen, Nordlichtern, der Sonnenkorona und Zodiakallichtern). Das findet man alles im englischen Wikipedia- Artikel über ihn (https://en.wikipedia.org/wiki/Svante_Arrhenius). Er war außerdem im Vorstand der Schwedischen Gesellschaft für Rassenhygiene, was interessanterweise nicht im deutschen Wikipedia-Artikel über ihn steht.“ Zitatende

…Das Arrhenius also – nach heutiger Einschätzung – ein ziemlich übler und dazu noch sehr aktiver Rassist war, würde ihm, wäre er „Klimaskeptiker“ gewesen, sofort das wissenschaftliche Genick brechen. Als „Klimaforscher“ auf der richtigen Seite ist das jedoch nicht so.

Fleischmann hat dazu noch mehr recherchiert und schreibt

Zitat: „Svante Arrhenius und Greta – ein Rassist, der chronisch dilettierte und seine Verwandte

Eines der schlimmsten Beispiele für fehlende Integrität “ist der „Vater aller Klimahysteriker“, Svante Arrhenius. Ich wiederhole teilweise aus Kapitel 4.4.: Arrhenius verschwieg, dass er die Ergebnisse von Tyndall durch 3,6 dividiert hatte um eine Übereinstimmung mit seinen eigenen Versuchen zu „beweisen“. So etwas nennt man Betrug! Es ist lustig zu lesen, wie Arrhenius in seinem Buch „Worlds in the Making“ darüber fabuliert, dass die Erde früher wie die Sonne aufgebaut war, dann langsam abkühlte und sich eine feste Kruste bildete, sie im Inneren aber immer noch gasförmig sei (https://archive.org/details/worldsinmakingev00arrhrich/page/40). Genauso lustig ist seine Theorie, dass die Bergketten durch Schrumpfung der Erdkruste entstanden sind und dass es am Südpol mit durchschnittlich -10 °C um 10 °C wärmer sei als am Nordpol. Damit lag er um schlappe 40 °C daneben! Soviel zu seinem Verständnis von der Erdatmosphäre. Für die Mitteltemperatur der Venus kommt er auf 40 °C. Tatsächlich sind es 464 °C! Bei der Mitteltemperatur für den Mars lag er „nur“ um 93 °C daneben. Ein echter Klimaexperte eben…

Arrhenius war ein sehr umtriebiger Mensch. Er irrlichterte auch zu den Themen Panspermie (nach dieser Theorie kam das Leben durch Meteoriten auf die Erde), Immunchemie (hier lag er im Widerspruch zu Paul Ehrlich und somit auch falsch) und Astrophysik (mit falschen Theorien zu Kometen, Nordlichtern, der Sonnenkorona und Zodiakallichtern). Er war außerdem im Vorstand der Schwedischen Gesellschaft für Rassenhygiene.

Interessanterweise steht darüber nichts im deutschen Wikipedia-Artikel über ihn (aber hier: https://en.wikipedia.org/wiki/Svante_Arrhenius).

Komisch, dass manche Aktivisten Schnappatmung bekommen, wenn sie Straßennamen lesen, in denen das Wort „Mohr“ vorkommt, aber nichts zum Rassisten Arrhenius sagen, nicht wahr? Dessen Denkmal steht immer noch fest auf dem Sockel der Klimahysteriker. Soll man Arrhenius zugutehalten, dass der Rassismus zu seiner Zeit „wissenschaftlicher Konsens“ war? Hat er Nicht-Rassisten zugerufen „folgt der Wissenschaft“? Dieter Nuhr, übernehmen Sie!

Die Klimahysteriker erwähnen natürlich gerne seinen Nobelpreis. Arrhenius war ab 1900 am Aufbau der Nobelinstitute und des Nobelpreises beteiligt. Er bekam 1903 den dritten in Chemie vergebenen Nobelpreis für seine Forschungsarbeiten zur Leitfähigkeit von Elektrolyten. Ob er den Preis wirklich verdient hat, kann ich nicht beurteilen. Seine Ergebnisse waren jedenfalls wieder einmal quantitativ falsch, was wohl an seinem mangelnden Verständnis der Physik lag (www.chemiedidaktik.uni-oldenburg.de/download/Erich_Hueckel.pdf).

Es wäre nicht die einzige fragwürdige Entscheidung des Nobelkomitees gewesen. Ab 1905 war Arrhenius Mitglied des Nobelkomitees und Leiter des Nobelinstituts für Physik und nutzte seine Position, um mehreren Freunden Nobelpreise zukommen zu lassen und er versuchte, die Nobelpreise seinen Gegnern zu verwehren (https://en.wikipedia.org/wiki/Svante_Arrhenius, steht wiederum nicht in der deutschen Wikipedia). Soviel zum „ehrenwerten“ Herrn Arrhenius.

An dieser Stelle sollte sich jeder Klimawissenschaftler fragen, ob er lieber in der Tradition des Genies Maxwell oder des dilettantischen Betrügers und Rassisten Arrhenius stehen möchte.

Dass Arrhenius entfernte Verwandte Greta Thunberg von Physik auch nicht mehr versteht, muss man ihr nachsehen. Schließlich ist sie erst 16 und schwänzt oft den Unterricht, damit ihr Vater, Drehbuchautor Svante Thunberg, Stoff für seinen Film über die Familie der Klimapropheten bekommt. Das ist eine Unterstellung? Weshalb wohl hat Greta für ihre Selbstvermarktungs-Segeltour nach New York keinen Meeresbiologen mitgenommen sondern den Drehbuchautor und einen Kameramann? Und weil Greta medienwirksam mit einer energieaufwändig hergestellten Karbonfaser-Rennyacht segelt statt zu fliegen, müssen stattdessen sechs Segler über den Atlantik fliegen

(https://www.welt.de/wirtschaft/article198622037/Greta-Thunberg-Jetzt-ist-ihr-Segeltrip-nicht-mehr- sauber.html). Absurd und verlogen ist das, wie so Vieles, was von den Klimahysterikern kommt. Ihr Vater bekommt sicher den Oskar für sein Drehbuch zu Gretas Inszenierung. Wenn das Theater dann wenigstens vorbei wäre!

Und ihre Mutter bekommt natürlich den Literaturnobelpreis für Sätze wie „Greta gehört zu den wenigen, die unsere Kohlendioxide mit bloßem Auge erkennen können.“ Ich musste schallend lachend, als ich das zum ersten Mal las. Ist es ernst gemeint oder vom Drehbuchautor diktiert? Für dieses Wunder (Kohlendioxid ist unsichtbar und geruchlos) wird Greta dann vermutlich noch heiliggesprochen, zusammen mit den anderen „Wenigen“. Der Papst freut sich schon auf eine zweite Audienz bei ihr.

„How dare you!“ sollte ihr jeder ins Gesicht zurückbrüllen. „Gehe endlich zur Schule und lerne etwas Anständiges!“ (Bild: https://twitter.com/faznet/status/1122825109616644096/photo/1). Zitatende

Soweit Bernd Fleischmann

Und da schließt sich der Kreis.

Findet nicht auch Stefan Rahmstorf, dass Greta Thunberg gute wissenschaftliche Kenntnisse über Klimafragen hätte? Was wenig wundert, denn er selbst zeichnet ja als klimawissenschaftlicher Berater der heiligen Greta.

Und hatte nicht auch Rahmstorf versucht dem Kollegen Jan Veizer den Aufenthalt an der Bochumer Universität so zu vergällen (wie auch dem Kollegen Nir Shaviv, nur dass der an der Hebrew Universität in Jerusalem für Rahmstorfs Einschüchterungsversuche unerreichbar war), so dass dieser entnervt nach Kanada auswich? Und dass nur, weil dieser zusammen mit Nir Shaviv und Henrik Svensmark eine völlig andere Theorie über die Ursachen des Klimawandels aufgestellt und per vielfachen Beobachtungen und Messungen auch beweisen konnte?

„Gleich zu gleich gesellt sich gern“, sagt der Volksmund. Doch das wäre wohl eine klare Fehlinterpretation, denn von Rassismus ist nichts bekannt, und daher bleibt Rahmstorf ein ehrenwerter Mann und ehrenwerte Männer sind sie alle, die heutigen Klimaforscher um ihn herum. Schließlich veröffentlichen sie heute den 6. IPCC Sachverstandsbericht (AR 6). Und der ist nüchtern, sachlich und bar jeder Panikmache, wie auch die dazugehörige Summary for Policymakers (SPM), obwohl diese fast gänzlich von der Politik redigiert wurde. Dafür steht schon seine Überschrift: „Der Klimawandel verbreitet sich weiter, rasch und verstärkt“

von Alex Reichmuth

von Alex Reichmuth