Neue Studie: Temperaturrückgang um 1°C bis 2020 infolge der geringen Sonnenaktivität

Zentrale Punkte

• Ein längerer Sonnenzyklus zeigt niedrigere Temperaturen im darauf folgenden Zyklus an.

• Ein Temperaturrückgang um 1°C oder mehr wird im Zeitraum 2009 bis 2020 für bestimmte Gebiete vorhergesagt.

• Die Sonnenaktivität kann 40% oder mehr zur Erwärmung bis zum Ende des vorigen Jahrhunderts beigetragen haben.

• Eine Verzögerung von 11 Jahren ergibt eine maximale Korrelation zwischen der Länge eines Sonnenzyklus‘ und der Temperatur.

Die Autoren zeigen auch, dass die „Sonnenaktivität 40% oder mehr zur Erwärmung zum Ende des vorigen Jahrhunderts beigetragen haben kann“ und „an 3 Stationen im Nordatlantik zeigt sich ein solarer Beitrag von 63% bis 72% zum Temperaturanstieg der letzten 150 Jahre. Dies weist darauf hin, dass die Strömungen im Atlantik ein solares Signal verstärken“.

Ko-Autor der Studie ist der Geowissenschaftler Dr. Ole Humlum, der in einer früheren Studie nachgewiesen hatte, dass das CO2-Niveau der Temperatur auf kurzfristiger Basis hinterher läuft und dass CO2 nicht der Treiber der globalen Temperatur ist (hier).

Die Studie:

Der lange Sonnenflecken-Zyklus 23 sagt eine signifikante Abkühlung während des Zyklus‘ 24 voraus (hier)

Jan-Erik Solheim, Kjell Stordahl, Ole Humlum DOI: 10.1016/j.jastp.2012.02.008

Abstract

Beziehungen zwischen der Länge eines Sonnenflecken-Zyklus’ und der mittleren Temperatur im gleichen und dem darauf folgenden Zyklus werden für eine Anzahl von meteorologischen Stationen in Norwegen und dem Nordatlantik berechnet. Zwischen der Länge eines Zyklus‘ und der mittleren Temperatur im gleichen Zyklus konnte kein signifikanter Trend gefunden werden. Sehr wohl aber zeigte sich ein signifikanter negativer Trend zwischen der Länge eines Zyklus‘ und der mittleren Temperatur im darauf folgenden Zyklus. Dies stellt ein Tool zur Verfügung, um eine mittlere Temperaturabnahme von mindestens 1,0°C vom Zyklus 23 zum Zyklus 24 an den analysierten Stationen und Gebieten vorherzusagen. Für die untersuchten norwegischen lokalen Stationen fanden wir, dass 25% bis 56% der Erwärmung der letzten 150 Jahre der Sonne zugeordnet werden kann. Für 3 nordatlantische Stationen zeigt sich sogar ein Beitrag von 63% bis 72%. Dies deutet darauf hin, dass atlantische Strömungen ein solares Signal verstärken.

Introduction

Der Frage nach einer möglichen Beziehung zwischen der Sonnenaktivität und dem Erdklima ist während der letzten 200 Jahre bedeutende Aufmerksamkeit zuteil geworden. Perioden mit vielen Sonnenflecken und Protuberanzen korrespondieren mit Perioden höherer Einstrahlung im sichtbaren Spektralbereich und sogar noch stärkerer Beeinflussung im Ultraviolett, welches auf die Ozonschicht einwirkt. Es wird auch gezeigt, dass galaktische kosmische Strahlen als Kondensationskerne für Wolken fungieren können. Dies kann ein Link sein zwischen Variationen der Wolkenbedeckung und der Sonnenaktivität, da mehr kosmische Strahlen das Magnetfeld der Erde durchdringen, wenn die Sonnenaktivität gering ist. Eine Übersicht über mögliche Verbindungen zwischen der Sonne und dem Erdklima findet sich bei Gray et al. (2010).

Auf der Grundlage einer starken Korrelation zwischen der Entstehungsrate kosmogenischer Nukleide 14C und 10Be sowie Proxys aus den Strömungen des Meereises kamen Bond et al. (2001) zu dem Ergebnis, dass extrem schwache Durchdringungen des Outputs der Sonnenenergie im Zeitscale von Jahrzehnten und Jahrtausenden eine starke Reaktion des Klimas in der Tiefsee des Nordatlantik (NADW) zur Folge haben. Dies beeinflusst die globale thermohaline Zirkulation und das globale Klima. Die mögliche Beziehung zwischen Sonne, Ozean und Klima kann in Temperaturreihen aus dem Gebiet des Nordatlantik hervorgehen. Da der Ozean mit seiner großen Wärmekapazität gewaltige Wärmemengen speichern und transportieren kann, ist eine zeitliche Verzögerung zwischen der Sonnenaktivität und einer Zunahme der Lufttemperatur zu erwarten. Eine beobachtete Zeitverzögerung gibt uns die Möglichkeit für eine Vorhersage, was die Grundlage dieser Untersuchung ist.

Beim Vergleich der Sonnenflecken-Zahlen und der Temperaturanomalien auf dem Festland der Nordhemisphäre haben Friis-Christensen and Lassen (1991) ein ähnliches Verhalten zwischen der Temperatur und den Sonnenflecken-Zahlen von 1861 bis 1990 bemerkt, aber es schien, als ob die Sonnenflecken-Zahl R der Temperatur-Anomalie vorausläuft. Sie fanden eine viel bessere Korrelation zwischen der Länge eines Sonnenzyklus‘ (SCL) und der Temperatur-Anomalie. In ihrer Studie haben sie einen Mittelwert der SCL verwendet, der über 5 Zyklen nach der Methode 1-2-2-2-1 geglättet worden ist. Sie korrelierten die Temperatur während des zentralen Sonnenflecken-Zyklus‘ des Filters mit diesem geglätteten, gewichteten Mittel für einen SCL. Grund für die Auswahl dieser Art Filterung war, dass er traditionell bei der Beschreibung langfristiger Trends der Sonnenaktivität verwendet worden ist. Allerdings ist es überraschend, dass die Temperatur nicht in der gleichen Weise geglättet wurde. In einer Folgestudie kamen Reichel et al. (2001) zu dem Ergebnis, dass die richtige Ursache-Wirkung-Reihenfolge im Sinne der Granger-Kausalität [?] in der geglätteten SCL und der mittleren Temperaturanomalie während eines Zyklus‘ gegenwärtig ist, und zwar für die Festlands-Temperatur auf der Nordhemisphäre im 20. Jahrhundert mit einem Signifikanz-Niveau von 99%. Dies zeigt, dass ein physikalischer Mechanismus existiert, der die Sonnenaktivität mit Klimavariationen in Zusammenhang bringt.

Die Länge eines Sonnenzyklus’ wird definiert durch das Erscheinen des ersten Sonnenflecks in einem Zyklus auf einer hohen solaren Breite bis zum Verschwinden des letzten Flecks im gleichen Zyklus nahe dem Sonnenäquator. Bevor jedoch der letzte Fleck eines Zyklus‘ verschwindet, zeigt sich bereits der erste Fleck des folgenden Zyklus‘ in hohen Breiten, wobei es normalerweise zu einer Überlappung von zwei Jahren kommt. Die Zeit des Minimums wird definiert als der Mittel-Zeitpunkt der Überlappung zwischen den beiden Zyklen (Waldmeier, 1939), und die Länge eines Zyklus‘ kann gemessen werden zwischen aufeinanderfolgenden Minima oder Maxima. Die neueste Beschreibung, wie man die Zeit des Minimums berechnen kann, stammt von NGDC (2011): „Wenn es die Beobachtungen zulassen, kann ein Datum, dass entweder als Minimum- oder Maximum-Zeitpunkt eines Zyklus‘ gewählt worden ist, teilweise basiert werden auf ein Mittel der Zeitpunkte, an denen die monatliche mittlere Sonnenflecken-Zahl ein Extrem erreicht und auf die mittlere monatliche Anzahl von Sonnenflecken-Gruppen allein. Zwei weitere Messungen werden zur Zeit des Sonnenflecken-Minimums verwendet: Die Anzahl der Tage ohne Sonnenflecken und die Häufigkeit des Auftretens von Sonnenflecken des alten und des neuen Zyklus‘ gleichzeitig“.

Lange Zeit hatte man gedacht, dass das Auftauchen eines Sonnenzyklus’ lediglich eine zufällige Sache war, was bedeutet, dass Länge und Amplitude eines jeden Zyklus’ unabhängig vom jeweils vorigen waren. Allerdings zeigte Dicke (1978), dass im Inneren der Sonne ein interner Chronometer existieren muss, der nach einer Reihe kürzerer Zyklen wieder längere Zyklen auslöst, so dass das Mittel der 11,2 Jahre beibehalten wird. Richards et al. (2009) analysierten die Länge der Zyklen von 1610 bis 2000 mit Hilfe von Median-Trace-Analysen [?] der Zykluslängen und Analysen des Energiespektrums der O-C-Restgrößen der Zeitpunkte von Sonnenflecken-Maxima und –Minima. Sie identifizierten eine Periode von 188 ± 38 Jahren. Sie fanden auch einen Zusammenhang zwischen langen Zyklen und Minima der Fleckenzahlen. Ihre Studie zeigt, dass die Länge von Sonnenflecken-Zyklen während der nächsten ~75 Jahre graduell zunehmen müsste, begleitet von einer graduellen Abnahme der Sonnenflecken-Zahlen.

Eine Autokorrelations-Studie von Solanki et al. (2002) zeigte, dass die Länge eines Sonnenzyklus‘ ein guter Prädiktor für die maximale Sonnenfleckenzahl (Rmax) im folgenden Zyklus ist, und zwar in dem Sinne, dass kurze Zyklen hohe Rmax und lange Zyklen niedrige Rmax prognostizieren. Sie erklären dies mit dem Sonnendynamo, der sich die Länge des vorangegangenen Zyklus‘ merkt.

Unter der Annahme einer Relation zwischen der Sonnenfleckenzahl und der globalen Temperatur könnte die profane periodische Änderung einer SCL auch korrelieren mit der globalen Temperatur, und solange wir uns auf dem aufsteigenden (oder absteigenden) Ast der 188-Jahres-Periode befinden, können wir ein wärmeres (oder kälteres) Klima vorhersagen.

Auch wurde gezeigt (Friis-Christensen and Lassen, 1992, Hoyt and Schatten, 1993 und Lassen and Friis-Christensen, 1995), dass die Korrelation zwischen SCL und Klima möglicherweise seit Jahrhunderten aktiv ist. Eine statistische Untersuchung von 69 Sätzen von Baumringen, die über 594 Jahre abdeckt, und SCL zeigte, dass dickere Baumringe (bessere Wachstumsbedingungen) in Verbindung standen mit kürzeren Sonnenflecken-Zyklen (Zhou and Butler, 1998).

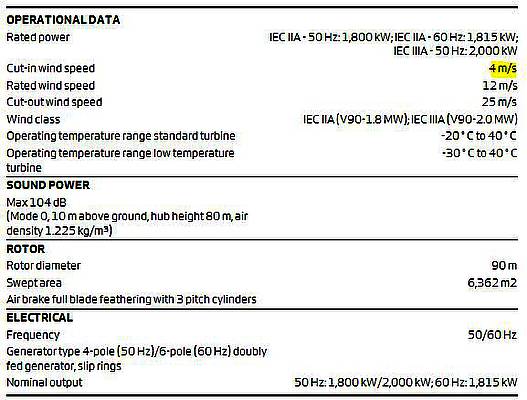

Die Relation zwischen der geglätteten SCL und der Temperatur funktionierte sehr gut, solange die SCL abnahm, wie in Abbildung 1 gezeigt. Aber zum Ende des kurzen Zyklus‘ 22 haben Thejll and Lassen (2000) von einer sich entwickelnden Inkonsistenz gesprochen. Um die hohen Temperaturen zur Jahrtausendwende zu erklären, musste der noch nicht beendete Zyklus 23 kürzer als 8 Jahre sein, was sehr unwahrscheinlich war, weil noch nie zwei derartig kurze Zyklen nacheinander beobachtet worden sind (siehe Abbildung 1). Sie schlossen daraus, dass die Art Sonnentreiber wie von diesem SCL-Modell beschrieben die Temperaturänderung nicht mehr so stark dominiert. Die endgültige Länge des Zyklus‘ 23 betrug schließlich 12,2 Jahre; die Diskrepanz wurde sogar noch größer.

Abbildung 1: Länge von Sonnenzyklen (invers) 1680 bis 2009. Der letzte Punkt bezieht sich auf den Zyklus 23, der 12,2 Jahre lang war. Die graduelle Abnahme der Länge von Sonnenzyklen wird mit einer geraden Linie dargestellt.

…

Schlussfolgerungen

Signifikante lineare Relationen wurden gefunden zwischen der mittleren Lufttemperatur während eines Sonnenzyklus’ und der Länge des vorangegangenen Zyklus’ (PSCL) für 12 von 13 Stationen in Norwegen und im Gebiet des Nordatlantik. An neun dieser Stationen wurde keine Autokorrelation auf dem 5%-Signifikanz-Niveau in den Restgrößen gefunden. An vier Stationen war der Autokorrelationstest unbestimmt, aber die Signifikanz der PSCL-Relationen erlaubte Vorhersagen für drei dieser Stationen mit einem Vertrauensniveau von 95%. Signifikante Relationen fanden sich auch hinsichtlich der gemittelten Temperaturen für Norwegen, die Temperaturanomalie an 60 europäischen Stationen sowie für die Temperaturanomalie bei HadCRUT3N. Die Temperaturen für Norwegen und dem Mittel von 60 europäischen Stationen zeigten indifferente oder gar keine Autokorrelationen in den Restgrößen. Die HadCRUT3N-Reihen zeigten signifikante Autokorrelationen in den Restgrößen.

Für die mittleren Temperaturen von Norwegen und die 60 europäischen Stationen liegt der solare Beitrag zu Temperatur-Variationen im untersuchten Zeitraum in einer Größenordnung von 40%. Ein sogar noch höherer Beitrag (63% bis 72%) wurde an den Stationen Färöer-Inseln, Island und Svalbard gefunden. Das ist höher als die 7% solarer Beitrag zum globalen Temperaturanstieg, der im AR 4 des IPCC genannt worden ist. Etwa 50% der Temperaturvariationen im HadCRUT3N-Datensatz seit 1850 kann der Sonnenaktivität zugeordnet werden. Allerdings ist diese Schlussfolgerung unsicherer wegen der in den Restgrößen gefundenen starken Autokorrelationen.

Die signifikanten linearen Relationen zeigen eine Verbindung zwischen der Sonnenaktivität und den Temperaturvariationen für die untersuchten Stationen und Gebiete. Ein Regressionsmodell auf der Grundlage der Relation zwischen PSCL und der mittleren Lufttemperatur wird verwendet, um die Temperatur im begonnenen Zyklus 24 vorherzusagen. Dieses Vorhersagemodell hat im Gegensatz zur Mehrheit der anderen Regressionsmodelle mit erläuternden Variablen den Vorteil, eine erläuternde Variable – die Länge eines Sonnenzyklus‘ – fast ohne Unsicherheiten zu verwenden. Normalerweise müssen die erläuternden Variablen vorhergesagt werden, was natürlich signifikante zusätzliche Unsicherheiten bei der weiteren Vorhersage zur Folge hätte.

Unsere Vorhersage zeigt eine mittlere Abkühlung von 0,9°C in der Nordhemisphäre während des Zyklus’ 24. Für Messungen der Stationen südlich von 75°N liegt der Temperaturrückgang in der Größenordnung 1,0°C bis 1,8°C und kann auch bereits begonnen haben. Für Svalbard wird eine Temperaturabnahme der jährlichen Mitteltemperatur während des Zyklus‘ 24 um 3,5°C vorhergesagt. Eine sogar noch stärkere Abkühlung wird für die Wintermonate vorhergesagt (Solheim et al., 2011).

Die arktische Verstärkung infolge von Rückkopplungen durch Änderungen der Schnee- und Eisbedeckung hat die Temperatur nördlich von 75°N um den Faktor 3 stärker zunehmen lassen als südlich von 60°N (Moritz et al., 2002). Eine Abkühlung der Arktis könnte hinsichtlich einer globalen Abkühlung in gleicher Weise wirken, was zu einer geringeren globalen Abkühlung während des solaren Zyklus‘ 24 führen würde, und zwar um 0,3°C bis 0,5°C.

Unsere Studie hat sich auf einen Effekt konzentriert, der eine Sonnenzyklus-Länge verzögert auftritt, um ein Modell zur Vorhersage zu entwickeln. Da sich der solare Antrieb des Klimas in vielen Zeitmaßstäben zeigt, behaupten wir nicht, dass unser Ergebnis ein komplettes Bild des solaren Antriebs unseres Erdklimas vermittelt.

Link: http://wattsupwiththat.com/2014/06/13/new-study-suggests-a-temperature-drop-of-up-to-1c-by-2020-due-to-low-solar-activity/

Übersetzt von Chris Frey EIKE